«Big Data» ist in aller Munde: Die datenbasierte Wertschöpfung ist ein mächtiges Instrument, um Vorgänge in Firmen und im Markt zu analysieren und zu verstehen. Sie wird damit zum Kompass für die strategische und operative Steuerung des Geschäfts. Folgendermassen können Firmen profitieren:

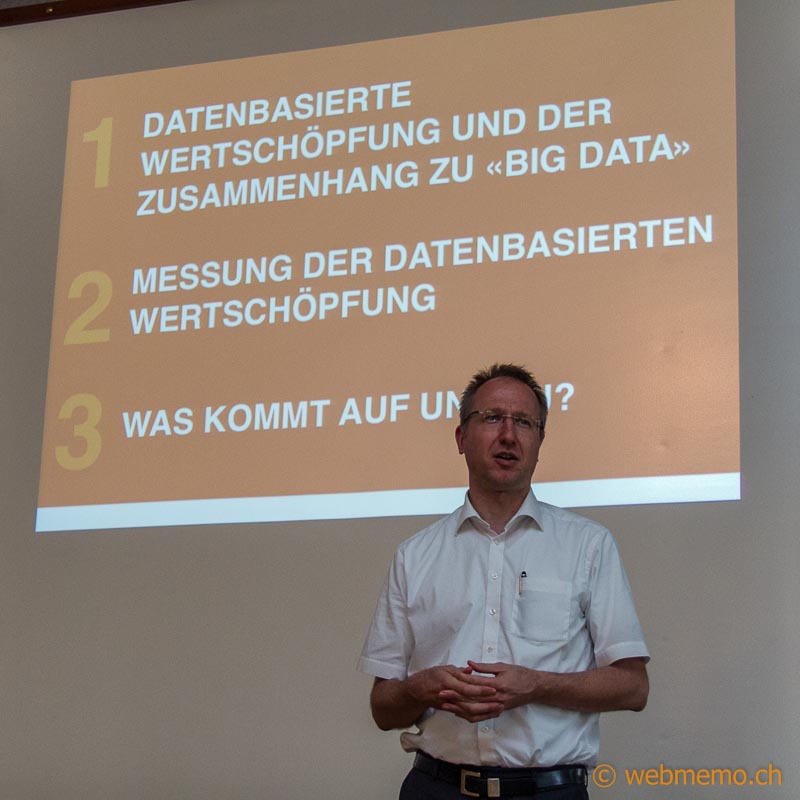

Vortrag von Simon Hefti von D1 Solutions am Internet Briefing.

Was ist datenbasierte Wertschöpfung?

Heute können anhand von Videosequenzen Scheidungen mit einer Sicherheit von 94% vorausgesagt werden… Wie im Privaten ist auch geschäftlich das Vorausschauen nützlich und potentiell wertvoll.

Selektion

In der Werbung ist die Selektion des allenfalls interessierten Nutzerkreises zentral. Das spart Kosten in der Ansprache und erhöht die Konversionsraten. Ãœblicherweise entwickelt man heute ein Modell basierend auf Vergangenheitsdaten. Ist das Modell validiert, wendet man es auf den aktuellen Kundenstamm an und misst den Erfolg der Werbemassnahme.

Vorhersage

Kunden künden selten aus dem Affekt sondern am Schluss einer Kette von Ereignissen. Die Frage ist also, ob man die Kette erkennen und dann die Kündigung abwenden kann. Oft sind dafür erstaunlich wenige, dafür umso stärkere Indikatoren ausschlaggebend.

Prozess-Analyse in Real-Time

Teuer ist eine Produktionsstrasse immer dann, wenn sie stillsteht. Entsprechend versucht man die Auslastung möglichst hoch zu halten und die Lieferketten effizient zu strukturieren. Handlungspläne für alle möglichen Situationen sollen eine allfällige Ausfallzeit möglichst kurz halten.

Analyse des Geschäftsverlaufs

Versicherungen verwalten Rückstellungen datenbasiert, um ein Optimum an Liquidität und gebundenen Mitteln zu erzielen.

Personalisierung

In der personalisierten Medizin steuert man die individuelle Behandlung von Patienten, da alle unterschiedlich auf die selben Medikamente ansprechen. Auch hier hilft die Analyse von grossen Datensätzen.

Vorbeugende Wartung

Logischerweise wartet man die am stärksten beanspruchten Teile am meisten. Bei Flugzeugen werden beispielsweise die Turbinen am intensivsten überwacht und entsprechend gewartet. Anhand des riesigen Datensatzes von Flugverbindungen wird versucht, allenfalls nächstens auftretende Probleme zu erkennen.

Erfolgsfaktoren und Risiken

Was muss ich beachten, damit das Instrument wirksam wird? «It’s the impact, stupid!»

Um den Impact zu messen braucht man die richtigen Antworten zur richtigen Zeit. Dafür braucht man erstmal die richtigen Fragen:

- Wer sind meine wichtigsten Kunden?

- Wo habe ich die besten Konversionsraten?

- Wie ist der Einfluss des Wetters auf mein Geschäft?

- Wo sollte ich Werbung schalten?

Wie findet man den richtigen Zeitpunkt? Eine Kündigungsabwendung kommt zu spät, wenn eine Kündigung bereits eingetreten ist…

Die Qualität der Informationen ist die dritte relevante Komponente: Wenn Kündigungen von insolventen Firmen kommen, so ist das logisch. Hier nützt auch eine Vorwarnung nicht viel bezüglich Churn-Management.

Anhand des Kassabons lassen sich heute Schwangere identifizieren inklusive relativ genauem Geburtszeitpunkt (Fall «Target» in den USA). Betroffene fühlen sich dadurch aber überwacht, die Information kann kontraproduktiv sein.

Wertanalyse

Zutat 1: Man braucht verwendbare Daten, wahrscheinlich aus verschiedenen Datensilos wie CRM, Social Media, etc. Die Data-Governance wird hier zum zentralen Thema: Wie geht man mit dem Status der Daten um, wer bringt Updates an? Welche Krankheiten gelten als Lifestyle-Probleme und wie werden sie diagnostiziert?

Der Feedback-Loop, beispielsweise die Freundschaftsvorschläge von Facebook, hilft, den Algorithmus zu verbessern, indem man eine Annahme des Systems bestätigt.

Empfehlungssysteme unterliegen oft dem Problem der Selbstverstärkung: Weil eben ein Buch empfohlen wurde, verkauft es sich besser, wodurch es in der Hitparade noch weiter steigt.

Zutat 2: Das richtige Team für die Datenanalyse und deren Interpretation ist ausschlaggebend. Daten werden oft in verschiedenen Umgebungen generiert durch unterschiedliche Nutzer. Deren Interpretation ist also nicht ohne Weiteres möglich, allenfalls ist eine Normalisierung nötig. Dafür sind Kenntnisse des Geschäftsmodells und des relevanten Datenuniversums nötig.

Zutat 3: Die Pflege der Modelle ist essentiell. Der Fall von Google Flu-Trends zeigt, dass ein ehemals erfolgreiches Modell heute nicht mehr zwingend richtig ist, weil sich inzwischen unser Suchverhalten verändert hat.

Ausblick: was wird sich in den Unternehmen ändern?

Process Integration: Die aus den Datensätzen gewonnenen Erkenntnisse müssen in den Geschäftsprozess zurücklaufen. Amazon hat ein entsprechendes Modell für Predictive Ordering patentieren lassen: Bücher werden schon verschickt bevor sie überhaupt bestellt sind, weil anhand der Historie die Wahrscheinlichkeit berechnet wird, dass ein Buch tatsächlich bestellt wird.

Car for the Mind: Steve Jobs meinte, der Computer sollte sein wie ein Fahrrad für den Geist. Analog könnte man das Arbeiten mit Daten als das Auto für den Geist benennen.

Navigationssysteme sind heute oft besser als Intuition, da sie auf mehr Daten zurückgreifen können, z.B. Stauinformationen.

TL;DR

Man muss die Geschäftsprozesse verstehen, um Datensätze relevant analysieren zu können und daraus Geschäftsentscheide ableiten zu können. Man sollte weniger von Big Data sprechen als vielmehr von Big Impact.